Immer mehr Unternehmen haben erkannt, dass generative KI nicht nur ein Trend ist, sondern langfristig bleiben wird. Darum überlegen sie, wie generative KI nachhaltig eingesetzt werden kann. Dazu benötigen Unternehmen eine DSGVO-konforme Unternehmens-KI. Hier bietet amber eine passende Lösung. In diesem Artikel klären wir die Grundlagen, die geklärt sein müssen, um eine KI-Lösung für das eigene Unternehmen einzusetzen. Einige der typischen Fragen beim Einsatz von generativer KI sind die folgenden:

1. Wer haftet für KI-generierte Antworten?

2. Ist der Einsatz von KI Tools DSGVO-konform?

3. Werden die KI-Modelle mit unseren Daten trainiert?

4. Wer hat das Urheberrecht für KI-generierte Inhalte?

Inhaltsverzeichnis

Nachdem bereits in einigen anderen Blogartikel mögliche Anwendungsfälle sowie die technische Umsetzung (ohne einer tieferen Berücksichtigung des rechtlichen Aspekts) betrachtet wurden, geht es in diesem Beitrag explizit um den rechtlichen Rahmen beim Einsatz von künstlicher Intelligenz. Zunächst geht es daher also um eine kurze Definition der DSGVO:

Was ist die DSGVO und warum ist Sie beim Einsatz von KI wichtig?

Die Datenschutz Grundverordnung (DSGVO) stellt sicher, dass Daten und Privatsphäre von Personen und Unternehmen ausreichend geschützt sind. Da der Datenschutz ein fundamentales Grundrecht ist, zielt die DSGVO vor allen Dingen darauf ab, die personenbezogenen Daten der Bürger der Europäischen Union zu schützen. Auf der anderen Seite stärkt dies wiederum das Vertrauen der Nutzer und Verbraucher.

Obwohl die DSGVO eine EU-Verordnung ist, hat sie eine globale Reichweiter als rechtliche Verpflichtung und wird von anderen Ländern als Vorbild gesehen. Wer die DSGVO fachgerecht umsetzt, ergreift bestimmte Maßnahmen, um die Sicherheit der Daten zu gewährleisten und um einen Missbrauch zu vermeiden.

Durch verpflichtende Dokumentation der Datenverarbeitung wird zusätzlich eine Transparenz erschaffen, die Betroffenen die Möglichkeit gibt, sich über den Umgang der Daten zu informieren.

Neben diversen Chancen der generativen KI wie einer höheren Effizienz und Produktivität, Zeit und Ressourcenersparnis oder einem verbesserten Wissensmanagement, gibt es Risiken wie bspw. der Datensicherheit, dem Datenschutz, dem Risiko einer Falschinformation bzw. Plagiaten sowie Urheberrechtsfragen und Ethikverstößen.

Um die Chancen von generativer KI im Unternehmen nutzen zu können, geht es in der rechtlichen und auch technischen Gestaltung beim Einsatz von generativer KI vor allen Dingen darum, die Mehrwert möglichst effizient zu heben, während die Risiken minimiert werden.

4 rechtliche Anforderungen beim Einsatz von generativer KI

Die rechtlichen Anforderungen beim Einsatz von generativer KI beziehen sich rund um die Themen Datenverarbeitung, Datenschutz, Datensicherheit, Privatsphäre sowie Haftungsrisiken.

1. Datenverarbeitung und Datenschutz

- Es liegt in der Sache von generativer KI, das oft mit großen Datenmengen hantiert wird. Daraus ergibt sich die Herausforderung, dass es in der Praxis nicht möglich ist, personenbezogene Daten wie bspw. E-Mailadressen, Telefonnummern oder ähnlichen relevanten Daten wie Namen explizit rauszufiltern. Beim Einsatz von generativer KI ist daher zu berücksichtigen, inwiefern die Übergabe dieser sensiblen Daten notwendig ist oder sogar vermieden werden kann.

- Ist die Eingabe bzw. Verwendung personenbezogener Daten nicht zu vermeiden, dann sollte dies nur unter Berücksichtigung der DSGVO erfolgen. Nur dann kann ein rechtskonformer Einsatz der personenbezogenen Daten erfolgen.

- Da Kunden, Lieferanten oder Mitarbeiter im Zweifel ein Recht auf die Herausgabe der Daten bzw. ihrer Verarbeitung haben, sollten Unternehmen hiermit transparent umgehen und vertrauenswürdige KI-Lösungen auswählen. Somit sollte bei einer Zusammenarbeit zumindest in der Datenschutzerklärung über den Einsatz von KI informiert werden.

- Um diese Thematiken rechtlich sicher abzubilden, muss die richtige Rechtsgrundlage bestehen. Einerseits ist dies eine vorherige, entsprechende Einwilligung seitens der Nutzer oder ein berechtigtes Interesse. Da bei Lösungen wie amber eine Einführung durch das Unternehmen stattfindet, muss in unternehmensweiten Lösungen keine individuelle Einwilligung abgeschlossen werden. Stattdessen müssen Unternehmen mit einem KI-Anbieter ein AVV bzw. Auftragsverarbeitungsvertrag abschließen, in dem Dinge, wie bspw. Subauftragnehmer, technische und organisatorische Maßnahmen (TOM’s) etc. geklärt sind, um die Auftragnehmerdaten ausreichend zu schützen.

2. Datensicherheit und Privatsphäre

- Die bereits angesprochenen TOM’s sowie die Liste der beauftragten Subunternehmen zählen zur Datenschutzdokumentation und legen somit offen, wie der KI-Anbieter die Vorgaben aus der DSGVO umsetzt. Die klassischen Themen sind Dinge wie die Häufigkeit der Passwortwechsel, Zugriffsbeschränkungen/Kontrollen oder Themen wie Privacy by Design.

- Ein Punkt, den Unternehmen, die KI bei sich selbst einsetzen wollen, durchführen sollten, ist die Durchführung einer Datenschutz-Folgenabschätzung (DSFA). Diese ist dann erforderlich, wenn ein gewisses Risiko für die Rechte bzw. Freiheiten natürlicher Personen vorliegt.

3. Haftungsrisiken

Einer der größten Diskussionspunkte beim Einsatz von generativer KI in Unternehmen ist die Haftungsfrage. Zum Beispiel: Wer haftet, wenn auf Basis von einer KI fehlerhafte Entscheidungen getroffen werden?

Im Einzelfall können die anwendenden Unternehmen zur Haftung herangezogen werden. Nämlich dann, wenn es um Produzenten-, Anwender-, Produkthaftung oder Dinge wie die Verarbeitung bzw. den Datenschutz geht. Haftungsfragen können sich auf dem blinden Vertrauen auf den KI-Output oder der mangelnden Konsequenz ergeben.

So können Chatbots von Webseiten bspw. eine Herausforderung sein, da sie im Namen des Unternehmens sprechen und bspw. aus dem Kontext gerissene Garantieversprechen oder Eigenschaften nennen können.

Sollten sich jedoch Mitarbeitende die Antwort auf eine Kundenanfrage per KI ausgeben lassen und diese vor dem Versenden nicht sorgfältig prüfen, dann können sowohl das Unternehmen als auch der Mitarbeitende haften. Um solche Risiken zu minimieren, sollten Anwender ausführlich geschult werden.

Zur Einordnung: Verstoßen Unternehmen gegen Datenschutzrechtliche Vorschriften, dann können behördliche Bußgelder in der Regel bis zu 4% des Jahresumsatzes betragen. Umso wichtiger ist eine saubere und nachhaltige Umsetzung einer KI-Strategie.

Um Haftungsrisiken zu minimieren, sollten Unternehmen daher proaktiv reagieren und entsprechende Maßnahmen ergreifen wie bspw. die kontinuierliche Überprüfung und Auditierung der KI-Systeme.

Du willst mehr über das Thema DSGVO-konformer Einsatz von generativer KI erfahren? Dann sieh dir jetzt unser 40-minütiges Webinar zu diesem Thema an:

4. Der EU AI-Act

Der EU KI-Act ist im Juni 2024 in Kraft getreten und gibt dem Einsatz und der Programmierung von Künstlicher Intelligenz Regeln und Vorschriften. Ziel ist der ethisch verantwortungsvolle Einsatz von KI-Systemen in der EU.

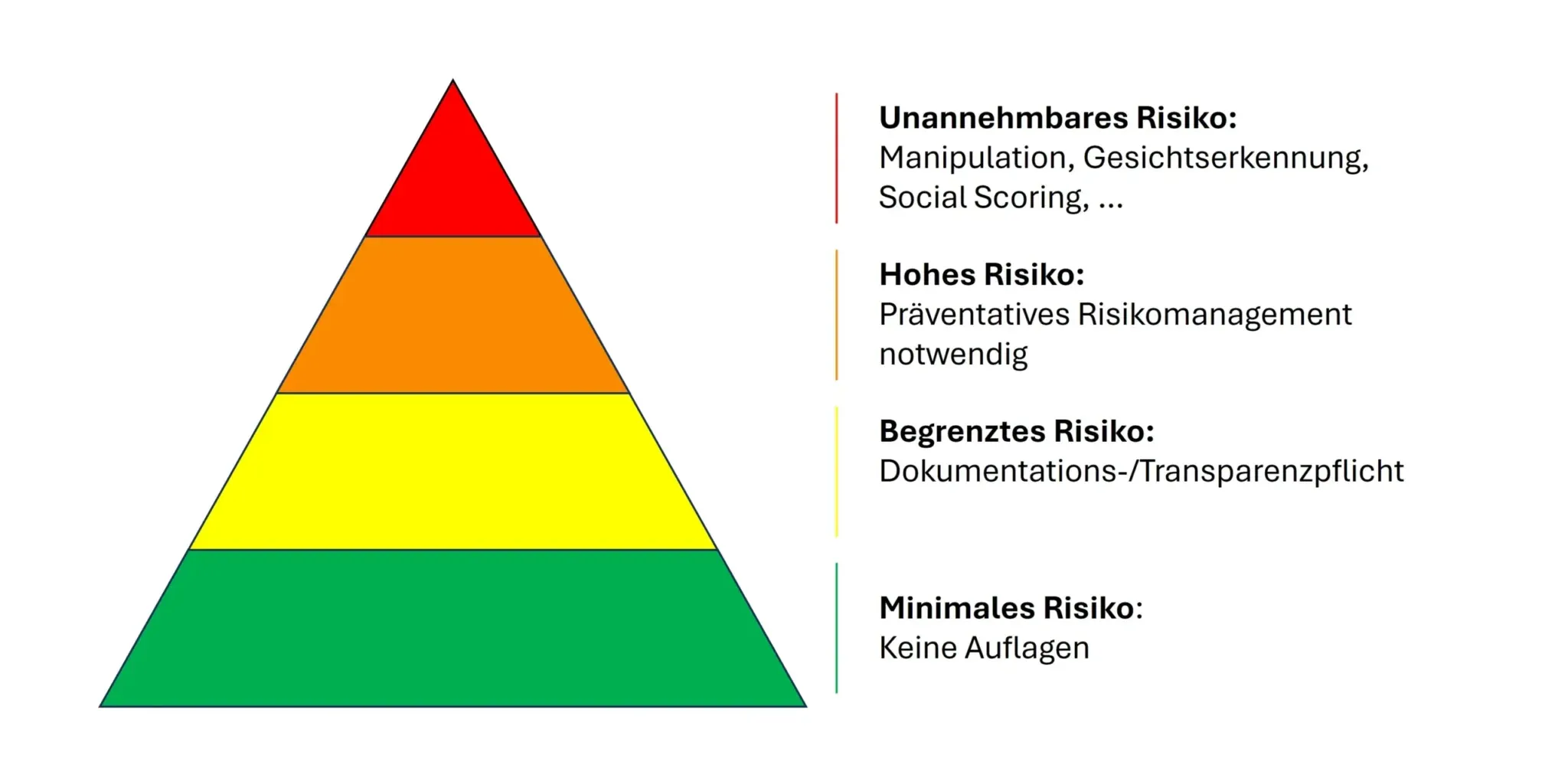

Im Kern unterteilt der KI-Act dabei KI-Anwendungen in verschiedene Risikoklassen, aus denen sich dann die sicherheitstechnischen Anforderungen ergeben.

Grafik, die die Risikoeinteilung des EU-KI-Acts zeigt

Dabei soll die Einteilung der Risikoklassen nach dem gezeigten Schema vollzogen werden.

Je nach Klassifizierung werden unterschiedlich hohe Hürden zur Einführung von KI im Unternehmen fällig. Der AI-Act betrifft sowohl Unternehmen, die KI entwickeln sowie die, die eine KI für ihre Kunden zur Verfügung stellen möchten. Dabei sollen zum Beispiel folgende Dinge bei der Entwicklung von KI-Systemen berücksichtigt werden:

- Das Verbot von Systemen, die Menschen klassifizieren oder sogenannte Social Scoring Systeme (unannehmbares Risiko)

- Die Entwicklung von KI-Systemen mit begrenztem Risiko soll unter Transparenz und Dokumentationspflichten passieren, um die Funktionsweise verstehen zu können und das Vertrauen zu stärken.

Um KI-Innovationen innerhalb der EU nicht zu hemmen, ist der AI-ACt eine Kombination aus Innovation und Sicherheit bei der Entwicklung und Nutzung von KI. Die Empfehlungen der EU für Anwender sehen daher wie folgt aus:

- Bewertung der KI-Anwendung nach Risikoklasse

- Einhaltung von Best Practices

- Dokumentation zur Nachvollziehbarkeit

- Schulung und Sensibilisierung

- Gesetzesänderungen im Blick behalten

So ordnet der Anwalt Christian Solmecke den AI-Act ein

Der AI-Act wird immer relevanter. Um das ganze rechtlich einzuordnen, hat YouTube-Anwalt Christian Solmecke von der Kanzlei WBS.Legal ein Video zu diesem Thema gedreht und den AI-Act eingeordnet. Sieh dir das Video hier an:

Wie kann man eine DSGVO-konforme Unternehmens-KI für Mitarbeitende bereitstellt

Grundsätzlich gibt es verschiedene technische Arten, wie man KI für Mitarbeitende zur Verfügung stellen kann. Diese sind zum Beispiel:

- Bereitstellung eines öffentlichen KI-Modells

- Eines eigenen KI-Modells

- In bestehende Lösungen integrierte KI-Lösungen

- KI-Assistenten

- Oder KI-Agenten bzw. generative AI-Search

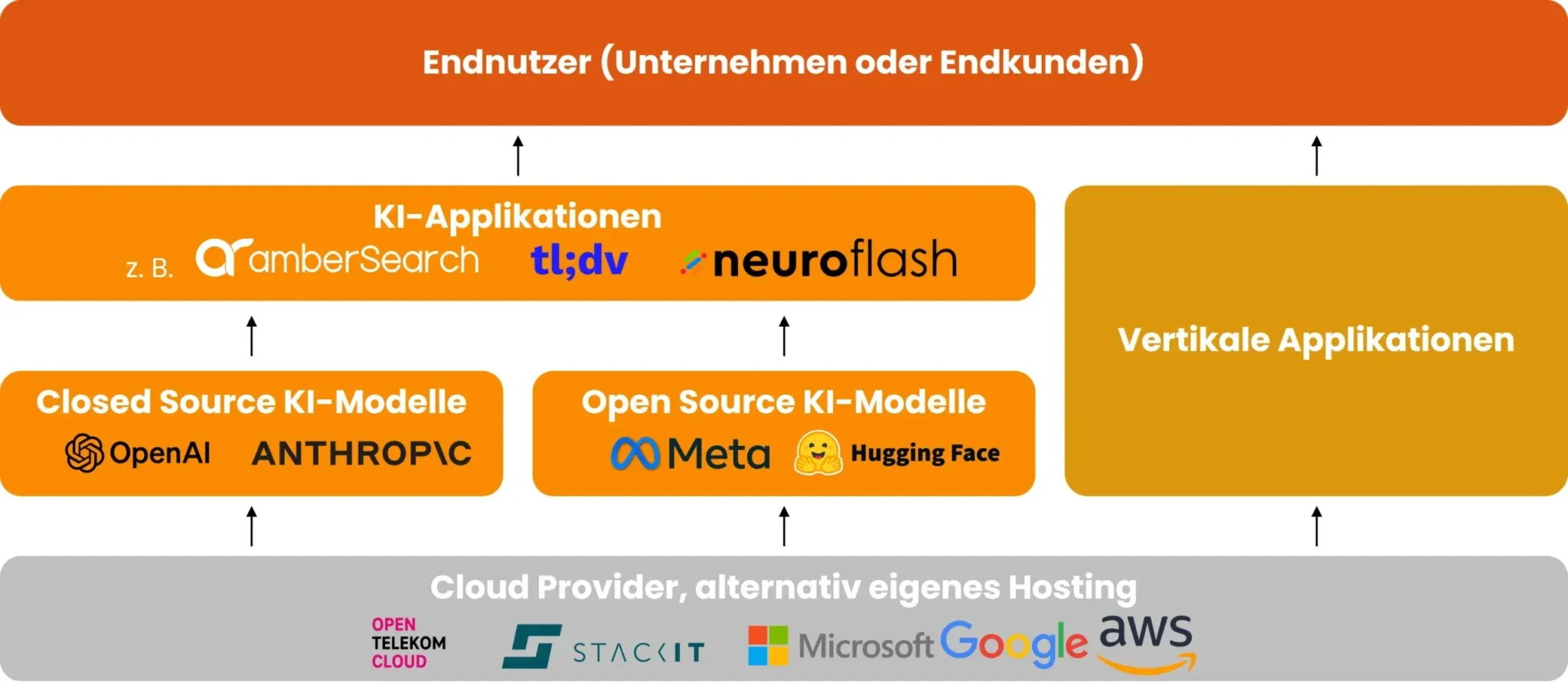

Um diese Lösungen nutzen zu können, gibt es verschiedene Möglichkeiten, wie sie aufgesetzt sein können. Mögliche Aufbauten wurden hier schematisch mit Beispielen dargestellt:

Aufbau der generativen KI-Landschaft

Für die meisten Unternehmen ist das Hosting auf eigenen Servern jedoch nicht sinnvoll, da die Kosten (alleine die Hardware ohne Installation liegt im mittleren fünfstelligen Bereich und höher) gerade im Mittelstand keine Berechnung eines Business Cases für den Einsatz von KI-Lösungen zulässt. Daher kommen zumeist Hyperscaler bzw. Cloudprovider zum Einsatz, die im Rahmen einer Private Cloud selbst eingekauft werden können oder im Rahmen eines klassischen Cloud-hostings vom KI-Anbieter gemanaged werden. Dieser Blogartikel vergleicht verschiedene Hostingmöglichkeiten.

Datenspeicherung und -verarbeitung in der EU

Die Datenspeicherung und -verarbeitung in der EU setzt eine DSGVO-konforme Verarbeitung und Speicherung voraus. Im Kern sollten dabei folgende Dinge zu berücksichtigen:

Interne Richtlinien legen fest, wie mit personenbezogenen Daten in KI-Systemen umzugehen ist. Dabei muss die Rechtmäßigkeit der Datenverarbeitung gewährleistet sein. Dies umfasst insbesondere das Vorliegen einer geeigneten Rechtsgrundlage, wie einer Einwilligung oder eines berechtigten Interesses, sowie die entsprechenden datenschutzrechtlichen Vereinbarungen. Da es in der Praxis oft schwer umsetzbar ist, gesonderte Einwilligungen einzuholen, müssen folgende Maßnahmen ergriffen werden:

- Abschluss eines Auftragsverarbeitungsvertrags (AVV) mit dem KI-Anbieter.

- Nennung des genutzten Anbieters in der Datenschutzerklärung und Dokumentation im Verzeichnis der Verarbeitungstätigkeiten.

- Vollständige Dokumentation der eingegebenen Daten.

- Überprüfung und gegebenenfalls Anpassung der technisch-organisatorischen Maßnahmen.

- Regelmäßige Durchführung von Anwenderschulungen.

- Sicherstellung der Durchsetzung der Betroffenenrechte durch geeignete Prozesse.

Datenverarbeitung und -speicherung in den USA

Gemäß des EU-US Data Privacy Frameworks sind US-Unternehmen, die nach diesem Framework zertifiziert sind, in der Lage, Daten in einem rechtlich sicheren Rahmen zu hosten. Nichtsdestotrotz beruht dieses Abkommen auf einer Vereinbarung, die jederzeit gekippt werden kann und dazu führt, dass getätigte Investitionen nicht mehr nutzbar sind. Gerade in geopolitisch unsicheren Zeiten merken wir, dass immer mehr Unternehmen auf souveräne Lösungen aus Deutschland bzw. der EU setzen. Dies führt dazu, dass das Handeln nach europäischen Werten gegeben ist und man aufgrund verschiedener Gesetze eine höhere Kontrolle über die eigenen Daten hat.

On Premise Lösungen/Verarbeitung auf eigenen Servern

Viele der genannten Herausforderungen (bspw. AVV, TOM’s, etc) fallen bei On-Premise Lösungen weg, da das anwendende Unternehmen dann für das Hosting der KI-Software verantwortlich ist. Allerdings sind dafür einerseits eine Menge an Hardwareressourcen, andererseits an Know-How notwendig, um solche Systeme aufzusetzen. Zusätzlich müssen die KI-Lösungen kontinuierlich weiterentwickelt werden und die Hardwareanforderungen können sich mit größeren Modellen verändern.

Damit jeder amber einmal ausprobieren kann, stellen wir amber in unserer Onlinedemo zur Verfügung:

KI und der Einsatz von amber in Unternehmen

Nun wurde viel über den rechtlich sicheren Einsatz von KI im Unternehmen geschrieben, weshalb wir uns mit amber zu diesem Thema positionieren wollen. Mit amber haben wir seit 2020 ein KI-Tool entwickelt, welches Know-How aus bestehenden Datensilos schnell und einfach nutzbar macht. Im Kern setzen wir dafür auf Contextual RAG, eine Weiterentwicklung des klassischen RAG-Verfahrens. Erfahre in unserem Webinar, wie du amber einsetzen kannst:

Für uns ist einerseits die Berücksichtigung bestehender Zugriffsrechte, andererseits aber auch der DSGVO-konforme Einsatz unserer Lösung von besonderer Bedeutung. Daher verfolgen wir eine Trusted Partner Strategie, d. h. wir hosten unsere Software nur dort, wo wir wissen, dass europäische Gesetze grundlegend eingehalten werden.