Im August 2024 ist der AI-Act (s, KI-VO bzw. KI-Verordnung) der EU in Kraft getreten. Schrittweise werden in den nächsten Monaten weitere Phasen aktiviert, die zum Beispiel die Pflicht zur KI-Schulung enthält. Dieser Blogartikel erklärt den AI-Act, gibt eine Übersicht über die verschiedenen Phasen des AI-Acts und bietet Lösungsmöglichkeiten, wie Unternehmen vorgehen können, um die Vorgaben gemäß Verordnung umzusetzen.

Inhaltsverzeichnis

Der AI-Act

Der AI-Act (Artificial Intelligence Act) der Europäischen Union ist ein Gesetz, welches darauf abzielt, die Entwicklung und Nutzung von Künstlicher Intelligenz (KI) in der EU zu regulieren. Der Vorschlag wurde erstmals im April 2021 von der Europäischen Kommission vorgestellt und ist am 1. August 2024 in Kraft getreten. Ziel des AI-Act ist es, ein ausgewogenes Verhältnis zwischen der Förderung von Innovation und der Gewährleistung der Sicherheit und Grundrechte der Bürger im Hinblick auf KI zu schaffen.

Zunächst hatte das in Kraft treten des AI-Acts keine unmittelbaren Auswirkungen auf Unternehmen und den Einsatz von KI. Dennoch sieht der AI-Act einen mehrstufigen Einführungsplan (Art. 113 KI-VO) vor, welcher durchaus Einfluss auf Unternehmen hat.

Phase 1 des AI-Acts | 02. Februar 2025: KI-Schulung & Lösungen mit unannehmbaren Risiken

Die erste Phase des AI-Acts wurde gem. Art. 113 KI-VO am 2. Februar 2025 erreicht. Ab diesem Datum treten z. B. folgende Vorgaben in Kraft:

- KI-Systeme mit unannehmbaren Risiken werden verboten (Art. 5 KI-VO)

Der AI-Act teilt KI-Lösungen in verschiedene Risikoklassen ein. Mit der nächsten Phase werden die KI-Lösungen mit dem größten (=unannehmbaren) Risiko verboten. Dazu zählen zum Beispiel Systeme mit folgenden Funktionen:

- Ausnutzung von Schwächen besonders schutzbedürftiger Personen

- Bewertung des sozialen Verhaltens (Social Scoring)

- Kognitive Verhaltensmanipulation

- Biometrische Echtzeit-Fernidentifizierung (mit wenigen Ausnahmen)

- Biometrische Kategorisierung

- Aufbau von KI-Kompetenz wird zur Pflicht (Art. 4 KI-VO)

Um sicher zu stellen, dass KI verantwortungsvoll und im richtigen Rahmen eingesetzt wird,

- Anbieter und Betreiber von KI-Systemen müssen interne KI-Kompetenzen aufbauen.

- Dies gilt für alle Organisationen, die KI einsetzen, unabhängig vom Risikograd der KI.

- Mitarbeiter und Auftragsverarbeiter müssen über ausreichende KI-Kenntnisse verfügen.

- Bei Bedarf müssen Schulungen und Ausbildungen durchgeführt werden.

Hinweis: Besonders die 2. Vorgabe betrifft alle Unternehmen in besonderem Maße, da auch Unternehmen, die Lösungen wie Microsoft Copilot, amber oder ChatGPT im Alltag einsetzen hier von betroffen sind und Schulungen der der Mitarbeitenden nachweisen können müssen. Daher haben wir eine KI-Schulung entwickelt, in der wir die notwendigen Inhalte gemäß AI-Act schulen. Du kannst dir den theoretischen Teil der Schulung hier kostenlos ansehen. Gerne unterstützen wir dich beim praktischen Teil, so dass du ein Zertifikat inklusive Nachweis erhältst. Was konkret geschult werden muss, erfährst du in unserem kostenlosen Webinar:

Du möchtest mehr erfahren oder sogar eine Schulung für dein Unternehmen bekommen? Dann nimm jetzt über unser Kontaktformular kontakt zu uns auf.

Phase 2 des AI-Acts | 02. August 2025: Hochrisikosysteme, KI-Modelle mit allgemeinem Verwendungszweck

Grundsätzlich umfasst Phase die Durchsetzung der Kapitel III Abschnitt 4, Kapitel V, Kapitel VII und Kapitel XII sowie Artikel 78 gelten ab dem 2. August 2025, mit Ausnahme des Artikels 101. Daraus leiten sich weitere, erweiternde Anforderungen für Betreiber von Hochrisiko KI-Systemen und Entwicklern von General Purpose Modellen ab:

- Hochrisiko KI-Systeme (Kapitel III KI-VO)

Der AI-Act teilt – wie in diesem Artikel beschrieben – KI-Systeme in verschiedene Risikostufen ein. Nachdem in Phase 1 bereits KI-Systeme mit unannehmbaren Risiken verboten wurden. Um die eingeführten Mechanismen zu überprüfen, führt Kapitel 3 verschiedene Kontrollinstanzen ein, die von den Ländern ab diesem Datum zur Kontrolle der Umsetzung vorzuhalten sind. Folgende Dinge gelten für Hochrisiko KI-Systeme

- Risikobewertung und Qualitätsmanagement: Unternehmen müssen sicherstellen, dass ihre Hochrisiko-KI-Systeme den Vorschriften hinsichtlich Transparenz, Nachvollziehbarkeit und Sicherheit entsprechen.

- Konformitätsbewertung: Vor der Markteinführung muss eine Konformitätsbewertung durchgeführt werden, um die Einhaltung der Anforderungen zu überprüfen.

- Dokumentationspflichten: Entwickler und Anbieter müssen umfassende technische Dokumentationen bereitstellen, die unter anderem die Funktionsweise, die Sicherheitsmaßnahmen und die potenziellen Risiken des Systems beschreiben.

- KI-Modelle mit allgemeinem Verwendungszweck (Kapitel V KI-VO)

Grundsätzlich steigen die Anforderungen an KI-Modellanbieter innerhalb der EU – insbesondere im Hinblick auf Trainingsdaten, Nutzung und Test- bzw. Freigabe der Systeme. Konkret bedeutet das:

- Unternehmen, welche KI-Modelle ohne quelloffenen Code entwickeln, müssen offenlegen, wie die KI trainiert wurde und welche Tests zur Entwicklung der KI entwickelt wurde.

- Darüber hinaus müssen Anbieter solcher KI-Modelle einen Ansprechpartner gegenüber der EU benennen, welcher als Ansprechpartner für Rückfragen diverser Art gilt.

- Anbieter allgemeiner KI-Modelle haben die Verpflichtung vor der Veröffentlichung von KI-Modellen gewisse Standardprotokolle und Test zur Bewertung des KI-Modells durchzuführen.

Phase 3 des AI-Acts | 02. August 2026: der Großteil des AI-Acts tritt in Kraft

An diesem Daten tritt der Großteil des AI-Acts in Kraft.

- Transparenz und Kennzeichnungspflicht (Art. 50 KI-VO)

Die Transparenz- und Kennzeichnungspflichten für KI-Systeme, die zur direkten Interaktion mit Menschen bestimmt sind, treten in Kraft. Dies betrifft insbesondere generierte Audio-, Bild-, Video- oder Textinhalte.

Phase 4 des AI-Acts | 02. August 2027: Komplette Gültigkeit des AI-Acts & Präzisierung der Einstufung von Hochrisikosystemen

- Einstufungsvorschriften für Hochrisiko-KI-Systeme (Art. 6 KI-VO)

Gemäß Artikel 6 der KI-Verordnung werden spezifische Anforderungen und Bedingungen für Hochrisiko-KI-Systeme definiert. Diese Einstufung erfolgt unabhängig davon, ob das KI-System

in Kombination mit einem Produkt oder eigenständig betrieben wird. Folgende Hauptkriterien gelten:

- Sicherheitsbauteil oder eigenständiges Produkt: Ein KI-System wird als hochriskant eingestuft, wenn es als Sicherheitsbauteil eines unter Anhang I genannten Produkts verwendet wird oder selbst ein solches Produkt ist.

- Konformitätsbewertung: Hochrisiko-KI-Systeme müssen einer Überprüfung durch Dritte unterzogen werden, bevor sie in Verkehr gebracht oder in Betrieb genommen werden dürfen.

- Mit dem 2. August 2027 wird der AI-Act vollumfänglich gültig

Mit diesem Stichtag wird der AI-Act für alle Unternehmen vollumfänglich innerhalb der EU verpflichtend werden. Dazu zählt zum Beispiel auch, dass GPAI-Modelle (General Purpose AI), die vor dem 2. August 2025 auf den Markt gebracht wurden, AI-Act-konform sein müssen.

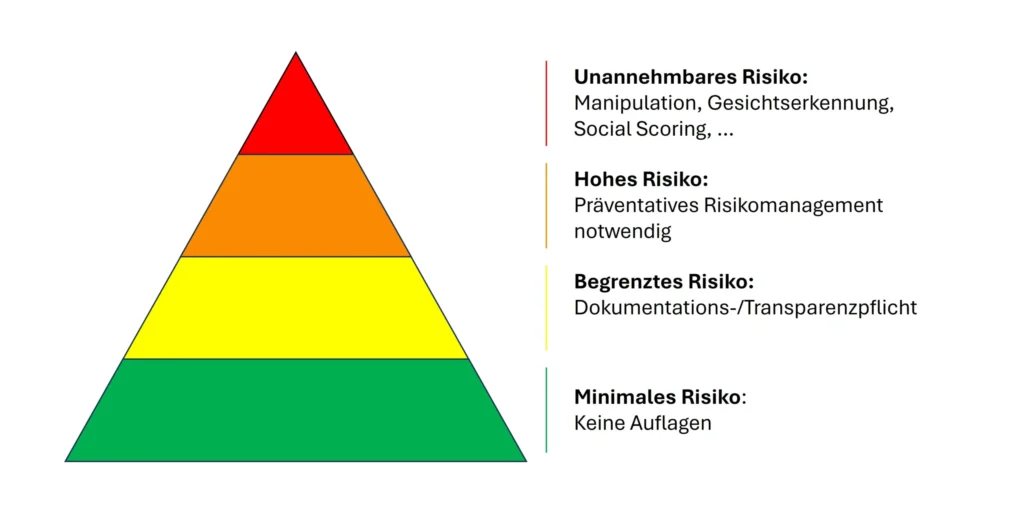

Einstufung Risikokategorien gemäß AI-Act

Der AI-Act teilt KI-Systeme basierend auf ihrem Risiko für Gesundheit, Sicherheit und Grundrechte in verschiedene Kategorien ein. Systeme mit einem unannehmbaren Risiko sind verboten, während für Hochrisiko-Systeme strenge Anforderungen wie Risikomanagement und Konformitätsbewertungen gelten. Systeme mit begrenztem Risiko unterliegen geringeren Auflagen, wie Dokumentationspflichten, und solche mit minimalem Risiko sind weitgehend frei von regulatorischen Anforderungen.

Risikoklassen des AI-Acts

Als Beispiele gelten folgende Systeme:

- Unannehmbares Risiko: Social Scoring durch staatliche Behörden, Manipulationssysteme zur Verhaltenssteuerung, unkontrollierte biometrische Überwachung wie Gesichtserkennung im öffentlichen Raum.

- Hohes Risiko: KI im Gesundheitswesen (Diagnosetools), KI-gestützte Prüfungssysteme für Bewerbungen oder Bildung, oder KI in der kritischen Infrastruktur (z. B. Energiemanagement).

- Begrenztes Risiko: Chatbots oder KI-gestützte Empfehlungssysteme auf Online-Plattformen.

- Minimales Risiko: KI-gestützte Rechtschreibprüfung, Musikempfehlungen oder personalisierte Werbung ohne sensiblen Datenbezug.

Compliance mit dem KI-Act – das müssen Unternehmen jetzt tun

Ab dem 2. Februar 2025 sind Unternehmen gemäß der EU-KI-Verordnung (KI-VO) verpflichtet, ihre Mitarbeitenden im Umgang mit Künstlicher Intelligenz (KI) zu schulen. Für Unternehmen, die KI anwenden ist dies aktuell der größte Einfluss, da eine Missachtung unter Umständen Geldbußen nach sich ziehen kann.

Warum ist eine KI-Schulung wichtig?

Die Einführung der KI-VO zielt darauf ab, den verantwortungsvollen Einsatz von KI-Systemen zu gewährleisten. Unternehmen müssen sicherstellen, dass ihre Mitarbeitenden über ausreichende Kenntnisse in Bezug auf die Funktionsweise, Anwendungsmöglichkeiten und Risiken von KI verfügen. Dies fördert nicht nur die Compliance, sondern stärkt auch das Vertrauen in KI-gestützte Prozesse.

Inhalte einer effektiven KI-Schulung für Unternehmen

Eine umfassende KI-Schulung sollte folgende Themen abdecken:

- Grundlagen der Künstlichen Intelligenz

- Einführung in die Funktionsweise von KI-Systemen

- Überblick über verschiedene KI-Modelle und deren Trainingsmethoden

- Anwendungsmöglichkeiten von KI in unterschiedlichen Geschäftsbereichen

- Chancen und Risiken von KI-Systemen

- Rechtliche und ethische Aspekte

- Detaillierte Erläuterung der EU-KI-Verordnung, einschließlich Risikoklassifizierung und Auswirkungen auf den Arbeitsalltag

- Rechtliche Verpflichtungen und Compliance-Anforderungen für Unternehmen

- Diskussion ethischer Fragestellungen im Umgang mit KI

- Datenschutz, Urheberrecht und Haftungsfragen im KI-Kontext

- Praktische Anwendung

- Vermittlung der Grundlagen zur Anwendung von generativer KI

- Praktische Übungen mit gängigen KI-Tools und -Plattformen

- Training im effektiven “Prompten” für die Nutzung von KI-Systemen

Abgeschlossen werden sollte die Schulung mit einem Test sowie dem Erhalt eines Zertifikats, so dass die Schulung auch nachgewiesen werden kann.

amber & der AI-Act

amber hat bereits 2020 angefangen, eine KI-basierte, unternehmensinterne Suchmachine zu entwickeln, die Mitarbeitenden hilft, schnell auf relevantes, internes Know-How zurückzugreifen. Immer schneller wachsende Datenmengen, immer mehr Datentöpfe und der Verlust von Wissensträger durch den demografischen Wandel führen dazu, dass es immer schwieriger wird, effizient mit Informationen im Unternehmen zu arbeiten. Stattdessen wird viel gesucht, Dinge erneut erarbeitet oder nur oberflächlich anstatt in der Tiefe gearbeitet, da die Zeit für belanglose „Suchaufgaben“ verloren geht. Mit amber haben Mitarbeitende hier eine einfache und passende Lösung.

Seit 2020 arbeiten wir bereits mit (zum Teil selbstentwickelten) Large Language Modellen und haben uns den DSGVO-konformen und verantwortungsvollen Einsatz schon lange vor dem Inkrafttreten des AI-Acts zu Herzen genommen. Mittlerweile wird unsere Lösung von über 200 Kunden genutzt – dort haben wir regelmäßig KI-Trainings und Schulungen gegeben. Auch auf unserem Blog haben wir bereits viel Wissen kostenlos zur Verfügung gestellt, um das Wissen über KI in der Gesellschaft zu erhöhen. Dieses Wissen möchten wir auch mit anderen Unternehmen teilen. Daher haben wir aus unserem Wissen eine Schulung entwickelt, welche gem. der KI-Verordnung alle wichtigen Inhalte berücksichtigt. Sprich uns gerne an.

Kontaktformular

Du hast Fragen zum AI-Act oder zur KI-Schulung? Dann kannst du uns hierüber problemlos kontaktieren. Wir freuen uns auf deine Kontaktaufnahme: